中国建设太空数据中心,这个思路真牛

最开始听到这个新闻的时候,我都愣住了,脑洞有些大啊。

北京拟在700-800公里晨昏轨道建设运营超过千兆瓦(GW)功率的集中式大型数据中心系统,以实现将大规模AI算力搬上太空。

🛰️ 计划核心信息一览

| 项目维度 | 具体内容 |

|---|---|

| 轨道位置 | 距地面 700-800公里 的晨昏轨道 |

| 系统规模 | 超过千兆瓦(GW)功率的集中式大型数据中心系统 |

| 系统组成 | 由空间算力、中继传输和地面管控分系统组成 |

| 核心目标 | 部署多座太空数据中心,每座功率约1GW,可容纳百万卡级别的服务器集群,开展天基数据中继传输和计算服务 |

| 当前进展 | 第一代试验星”辰光一号“已完成产品研制,正开展总装试验,拟于2025年底或2026年初择机发射 |

再看看规划情况,清晰明确。

🔭 分阶段建设规划

该计划拟分三个阶段实施,最终目标是支持未来的“天基主算”模式:

- 2025年至2027年:重点突破能源与散热等关键技术,研制试验星并建设一期算力星座,实现“天数天算”(太空数据在太空计算)的应用目标。

- 2028年至2030年:突破在轨组装建造等关键技术,降低成本,建设二期算力星座,实现“地数天算”(地面数据送往太空计算)的应用目标。

- 2031年至2035年:通过卫星大规模批量生产与组网发射,在轨对接建成大规模太空数据中心

除了震撼之外,我脑海里蹦出来好几个问题,我们来拆解一下这几个问题。

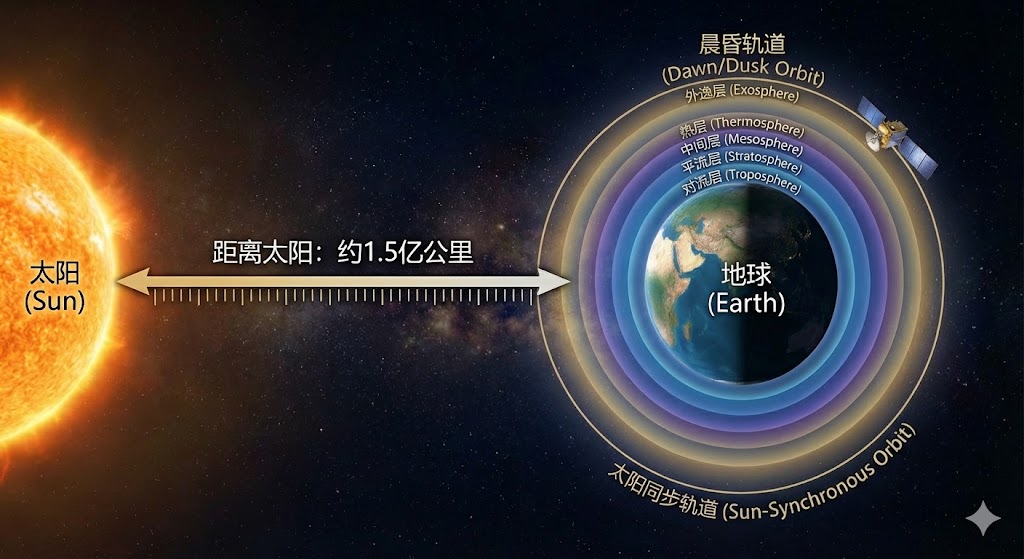

问题1、距地面 700-800公里 的晨昏轨道该如何理解?

我们看看几个轨道的核心区别(以太阳同步轨道为例)

| 轨道类型 | 核心特点 | 能源供应稳定性 | 适配场景 |

|---|---|---|---|

| 晨昏轨道 | 永久日照,无阴影期 | 100% 太阳能供应,无需大容量储能电池 | 高能耗设备(如千兆瓦级数据中心) |

| 太阳同步轨道 | 轨道平面随太阳公转,每天同一时间过同一点,有周期性阴影期(每次约 30 分钟) | 需配备大容量电池,能源供应有波动 | 遥感卫星、低功耗通信卫星 |

| 普通低轨轨道 | 交替进入日照区和阴影区,能源波动大 | 储能需求高,不适合持续高功率运行 | 低功耗通信卫星(如早期星链) |

数据中心里面对于电力的要求是极高的,而且算力的消耗不光是卡还有巨大的电力,晨昏轨道的 “永久日照” 特性,让太阳能电池板 24 小时满功率工作,光电转化率可达 40% 以上(地面仅 15-22%),且无需配备巨型储能电池(避免电池重量占用发射载荷,降低成本)。靠着太阳,相当于一座中型核电站。

另外散热部分,地面数据中心的散热能耗占总能耗的 30-40%,而 700-800 公里高度的真空环境,位置的温差极大,(-150℃~+120℃)

可通过 “辐射散热”(热量直接以红外线形式散发到太空)解决高功率散热问题 —— 真空无热传导 / 对流,散热效率是地面的 100 倍以上。这里肯定是有核心的创新技术。

问题2:超过千兆瓦(GW)功率的集中式大型数据中心系统是什么概念我们来看看功率的概念

- 1GW = 10 亿瓦,约等于一座中型核电站的输出功率,足以支撑100 万户家庭的日常用电

- 单座太空数据中心功率约1GW,多座集群总功率将超过 GW 级,相当于1000 座地面超算中心的总和

另外,和对面的数据中心相比,从功率,能效,规模等几个维度优势都很大

| 参数 | 北京太空数据中心 | 典型地面大型数据中心 | 差异说明 |

|---|---|---|---|

| 总功率 | 1GW / 座,集群超 GW 级 | 20-50MW / 座(约 0.02-0.05GW) | 单座太空数据中心功率是地面的20-50 倍 |

| 服务器规模 | 每座可容纳百万卡级别AI 服务器集群 | 10-20 万服务器 / 座 | 太空数据中心单座服务器数量是地面的5-10 倍 |

| 能源效率 | 24 小时100% 接收太阳能,光电转化率 > 40% | 受昼夜交替影响,平均仅 15-22%,需备用电源 | 能源效率是地面的2-3 倍,且无需储能设备 |

| 散热能耗占比 | 几乎为 0(利用太空真空辐射散热) | 30-40%(需大量冷却系统) | 节省地面数据中心1/3 以上的能耗 |

| 算力规模 | 2030 年达40 万 P(每秒千万亿次) | 一般不超过 1 万 P | 单座算力将是当前全国地面数据中心总和 |

- AI 算力需求爆发式增长,预计 2030 年全球算力需求将达200-300GW,远超地面电网承载能力

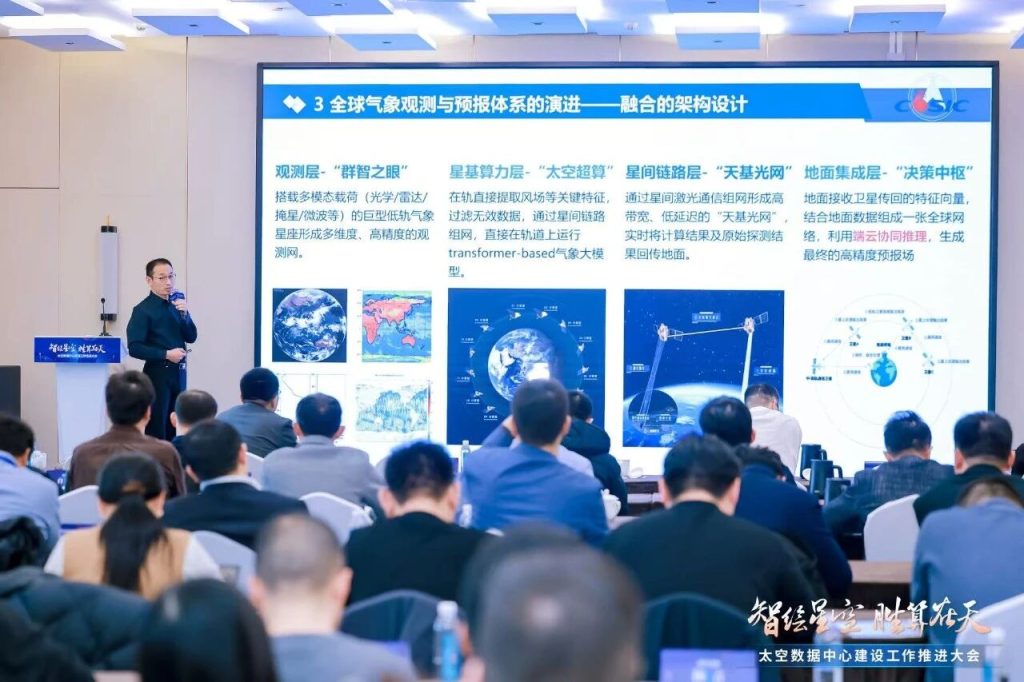

问题3:这么远的距离,如何连接?

这么远的距离,早就超过了地面数据中心之间互联的距离,信号衰减这些都不重要了。 这里的核心技术是激光通信。

. 核心连接技术:激光通信

- 采用高指向精度激光通信系统,在 700-800 公里距离上建立Gbps 级高速数据链路

- 中国已实现400Gbps星间激光通信,在 640 公里距离上稳定传输,精度达微弧度 (μrad) 级(相当于从北京瞄准上海的一枚硬币)

具体的通信技术原理我不专业,就不卖弄了。从带宽和延迟来看,效果了得。

- 单链路带宽达100-400Gbps,支持实时 AI 训练数据传输,比传统卫星通信提升300 倍

- 700-800 公里高度,单程通信延迟约20-30ms,远优于地球同步轨道 (约 250ms),完全满足 AI 训练和实时处理需求

- PUE值 太空≈1.05(几乎无能耗损失),地面≈1.4(损耗约 40%)

问题3:怎么运维?故障怎么处理?

这里肯定就涉及到硬件设备的故障和异常,包括过保运维,显然这么远的距离,修复效率肯定是受到影响的,而且实际上也不能靠人

- 700-800 公里高空环境极端恶劣:

- 温度波动:-150℃~+120℃(地面仅 – 40℃~+50℃)

- 强辐射:宇宙射线 + 太阳粒子,会损坏未保护的电子设备

- 微流星体撞击风险:速度高达25km/s,可击穿普通防护

- 载人维护成本极其高昂:一次载人任务约10 亿美元,且风险极高

因为没找到具体信息,我个人认为有以下几个策略:

1、应该还是增加冗余,做硬件级别的多重冗余

2、做细粒度的切分,减少异常和故障影响范围

3、自适应容错机制,隔离故障模块,维持系统整体功能4、另外硬件设备有过保周期,在这种条件下的使用周期就需要定制,增大设计使用寿命5、运维管理方式应该是无人值守,自动修复的方式问题4:其他国家是怎么规划的?在这一方面,美国是很有优势的,而且规划得也早。

| 国家 / 地区 | 规划名称 | 时间框架 | 算力规模目标 | 轨道高度 | 主要公司 / 机构 |

|---|---|---|---|---|---|

| 中国 | 天算计划 | 2025-2035 三阶段 | 2035 年超 GW 级,2800 颗星 | 700-800km (晨昏) | 北京星辰未来、国星宇航、之江实验室 |

| 美国 | Starcloud | 2025-2030 | 2030 年 1.2GW | 550-650km(LEO) | Starcloud、NVIDIA |

| 美国 | SpaceX 星链 + | 2025-2030 | 2030 年 100GW / 年 | 550-1500km(LEO) | SpaceX、X.AI |

| 欧盟 | ASCEND | 2021-2050 | 2050 年 1GW | 1400km (太阳同步) | Thales Alenia Space、ArianeGroup |

| 日本 | 太空集成计算网络 | 2022-2030 | 多层架构,GEO+LEO+HAPS | 36000km(GEO)+500-1500km(LEO) | NTT、SKY Perfect JSAT |

| 阿联酋 | Madari Space | 2026-2028 | 2028 年 8000 节点 | 500-700km(LEO) | Madari Space、NVIDIA |

| 印度 | 印度空间计算 | 2025-2030 | 通过私营企业实施 | 500-1000km(LEO) | ISRO、IN-SPACe、Pixxel |

| 澳大利亚 | 月球数据中心 | 2025-2030 | 月球轨道计算中继 | 月球轨道 | 澳大利亚航天局、NASA |

太空数据中心是一件大事,前期的基础建设投入成本是极高的,以1GW,15年周期为例,不过后期太空数据中心 15 年总拥有成本仅为地面同等规模的 1/5-1/6,主要得益于能源和冷却成本的 **90%+** 节省

| 成本类型 | 太空数据中心 | 地面数据中心 | 太空优势 |

|---|---|---|---|

| 建设投资 | 85-135 亿美元 | 500-600 亿美元 | 太空低75%+ |

| 15 年运营 | 12-20 亿美元 | 135-150 亿美元 | 太空低85%+ |

| 总计 | 97-155 亿美元 | 635-750 亿美元 | 太空仅为地面的 1/5-1/6 |

参考链接:

把大规模AI算力搬上太空,北京加速布局太空数据中心!

北京支持研发的首个算力星座将发射首颗算力实验卫星 太空有望迎来“巨型机房”

北京加速布局太空数据中心