AI算力扩容的新瓶颈竟是铜缆,英伟达押注光互连的深层逻辑

引言:从NVL72机柜的5000根铜缆说起

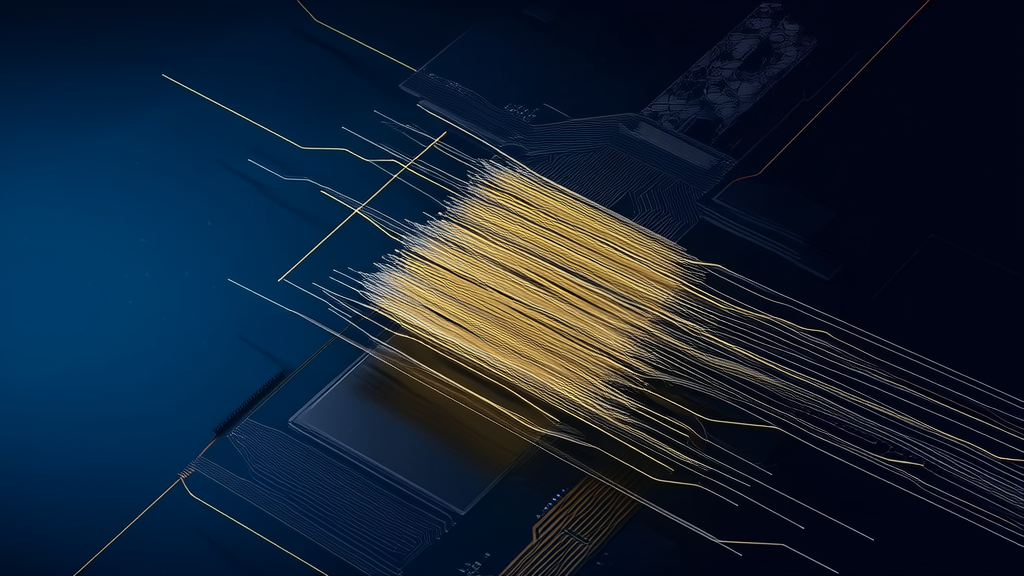

如果打开 Nvidia NVL72 机柜的后盖,你最先注意到的,可能不是那 72 颗 GPU,而是那超过 5,000 根同轴铜缆编织成的密网。这些铜缆总长超过 3.2 公里,是整台机柜 1.36 吨自重的主要来源。这个2024年GTC上展示的庞然大物,将铜缆在AI算力系统中的物理存在感展现得淋漓尽致。然而,仅仅两年后,2026年3月的GTC上,英伟达CEO黄仁勋宣布要用光互连把GPU系统从72颗扩展到576颗乃至1,152颗,并在一个月内向三家光学公司投了60亿美元。而在两年前,他还说光互连太耗电。

这背后引出一个核心问题:为什么英伟达在2024年还推崇铜缆(低成本、零功耗、高可靠性),却在2026年转向光互连?这反映了AI算力扩张的什么根本矛盾?本文将拆解铜缆的技术约束、光互连的突破逻辑、竞争格局变化,以及这一转变对行业的影响。

铜缆的黄金时代与物理极限:为什么它曾是首选,又为何成为瓶颈?

从第一性原理看,铜缆的技术本质是无源传输,依赖电信号在导体中的传播。其优势在于:

– 成本低:材料便宜。

– 功耗近乎零:无有源组件。

– 可靠性高:无激光器老化等问题,故障率低。

2024年GTC上,英伟达网络高级副总裁Gilad Shainer向媒体表示:“铜是最好的连接方式,如果你能用的话。它非常便宜,功耗为零,没有任何有源组件。”黄仁勋在同年GTC主题演讲中算过一笔账:如果NVL72用可插拔光模块替代铜缆,每颗Blackwell GPU需要配18个800 Gbps光模块,加速器端9个,交换机端9个,整套系统要多消耗约20,000瓦。对一台已经吃掉120千瓦的机柜来说,再加20千瓦不太切实。

然而,铜缆的约束条件在NVL72上已触及物理极限。在机柜正中央是9块NVSwitch托盘,被上下各9块计算托盘夹在中间。之所以这样排列,是因为铜缆信号在1.8 TB/s的带宽下跑不了几英尺就开始衰减,NVSwitch必须离每颗GPU尽可能近,居中是距离最短的布局。这迫使GPU规模扩展被限制在72颗左右,形成了硬上限。

量化来看,铜缆的优势与约束对比如下:

| 特性 | 铜缆 | 约束条件 |

|---|---|---|

| 成本 | 低(材料便宜) | – |

| 功耗 | 近乎零(无有源组件) | – |

| 可靠性 | 高(无激光器老化) | – |

| 传输距离 | – | 1.8 TB/s带宽下仅几英尺 |

| GPU扩展上限 | – | 约72颗(NVL72案例) |

铜缆曾是首选,因为它以低成本、零功耗和高可靠性满足了当时AI算力的需求,但距离衰减这一物理特性最终成为扩展瓶颈。

光互连的突破:英伟达如何从“太耗电”转向60亿美元投资?

光互连的技术本质是使用光信号在光纤中传输,打破了铜缆的距离和带宽约束,支持更长距离(可达公里级)和更高带宽(如800 Gbps模块)。但传统可插拔光模块存在两大问题:

– 功耗高:如NVL72估算的20,000瓦额外功耗。

– 可靠性问题:在接近百万条链路的大规模AI集群里,可插拔的光模块每天可能出现数十次链路中断。

2024年英伟达因此否定了光互连方案。但到2026年,关键约束被突破。2026年GTC上,英伟达推出铜光混合的Vera Rubin NVL576和Rosa Feynman NVL1152系统,结合CPO(共封装光学)技术,将光学元件更紧密集成到芯片中,减少功耗和延迟,从而将GPU系统从72颗扩展到576颗乃至1,152颗。

产品核心参数对比如下:

| 产品 | 连接技术 | GPU数量 | 推出时间 |

|---|---|---|---|

| NVL72 | 铜缆 | 72颗 | 2024年GTC |

| NVL576 | 铜光混合+CPO | 576颗 | 2026年GTC |

| NVL1152 | 铜光混合+CPO | 1,152颗 | 2026年GTC |

目标市场规模和增速方面,AI算力市场快速增长,光互连作为关键组件增速可能更高。2026年3月,英伟达向Coherent、Lumentum和Marvell投资60亿美元,锁定光学供应链,支持CPO技术部署,应对UALink竞争,旨在实现更大规模AI计算集群。

技术路线的关键约束是功耗和可靠性,而CPO技术通过紧密集成部分突破了这些约束,使光互连从“太耗电”变为“可以用”。

竞争格局与创新扩散:光互连如何重塑行业生态?

用波特五力分析竞争格局变化:

– 替代品威胁:铜缆作为传统方案面临光互连的替代,但混合方案可能成为过渡。

– 新进入者威胁:英伟达投资60亿美元加强垂直整合,应对UALink等竞品(如AMD、英特尔在高速互连领域的竞争)。

竞品的市场份额和定价对比:

– 英伟达在AI加速器市场占主导,份额超80%。

– 光互连领域有博通、思科等玩家。

– 定价方面,光模块成本高于铜缆,但CPO技术可能降低长期总拥有成本(TCO)。

创新扩散路径:从尝鲜者(早期AI超算用户)到主流市场需要以下条件:

1. 技术成熟度:CPO部署需稳定。

2. 成本下降:规模效应降低光模块成本。

3. 生态系统支持:供应链投资如60亿美元锁定光学组件。

4. 行业标准:如UALink的竞争推动互连协议发展。

英伟达的投资可能加速光学供应链整合,推动CPO技术普及,影响数据中心设计和能耗管理。

趋势研判与启示:AI算力扩张的未来路径与行业影响

基于素材,趋势研判可考虑三个情景:

1. 乐观情景:CPO技术快速成熟,光互连成为大规模AI集群标配,GPU规模突破千颗,驱动AI模型训练效率大幅提升。

2. 中性情景:铜光混合方案平稳过渡,铜缆在短距离场景保留,光互连逐步渗透,但供应链挑战延缓部署速度。

3. 悲观情景:CPO制造复杂性高,可靠性问题未完全解决,光互连推广受阻,AI算力扩展仍受铜缆限制。

领先指标可关注:

– CPO技术部署进度和故障率数据。

– 光学组件公司的产能和订单增长。

– AI算力集群中GPU数量的实际扩展情况。

行业影响:

– 英伟达的投资可能加速光学供应链整合,推动CPO技术普及。

– 对AI算力市场,突破物理极限支持更大模型训练(如千亿参数以上),驱动创新。

– 数据中心能耗管理可能优化,减少如20,000瓦额外功耗的潜在负担。

启示:

– 企业需关注光互连技术演进,评估TCO和可扩展性。

– 投资者可追踪光学组件公司和CPO进展。

– 这一转变凸显了AI基础设施中“连接”作为新瓶颈的重要性,未来可能催生更多跨领域创新,如硅光子技术与计算芯片的融合。

作为从业者,我观察到技术瓶颈往往出现在最意想不到的地方——这次是看似普通的铜缆。从数据库领域看,类似地,存储或网络延迟常成为系统性能的隐形杀手。解决之道不在于单一技术优化,而在于架构层面的突破,正如英伟达从铜缆转向光互连所展示的。未来,AI算力的竞争将愈发依赖于底层互连技术的创新,而不仅仅是GPU本身的算力提升。

关键数据与事实来源参考

- 如果打开 Nvidia NVL72 机柜的后盖,你最先注意到的,可能不是那 72 颗 GPU,而是那超过 5,000 根同轴铜缆编织成的密网。这些铜缆总长超过 3.2 公里,是整台机柜 1.36 吨自重的主要来源。

- 而在机柜正中央是 9 块 NVSwitch 托盘,被上下各 9 块计算托盘夹在中间。之所以这样排列,是因为铜缆信号在 1.8 TB/s 的带宽下跑不了几英尺就开始衰减,NVSwitch 必须离每颗 GPU 尽可能近,居中是距离最短的布局。

- 2026 年 3 月的 GTC 上,黄仁勋宣布要用光互连把 GPU 系统从 72 颗扩展到 576 颗乃至 1,152 颗,并在一个月内向三家光学公司投了 60 亿美元。

- 而在两年前,他还说光互连太耗电。

- 2024 年 GTC,Nvidia 第一次展示 NVL72 机柜(代号 Oberon)时,铜缆是理所当然的选择。Nvidia 网络高级副总裁 Gilad Shainer 向媒体表示:“铜是最好的连接方式,如果你能用的话。它非常便宜,功耗为零,没有任何有源组件。”

- 黄仁勋在同年 GTC 主题演讲中算过一笔账:如果 NVL72 用 pluggable optics(可插拔光模块)替代铜缆,每颗 Blackwell GPU 需要配 18 个 800 Gbps 光模块,加速器端 9 个,交换机端 9 个,整套系统要多消耗约 20,000 瓦。对一台已经吃掉 120 千瓦的机柜来说,再加 20 千瓦不太切实。

- 铜缆还有一个不常被提及的优势:可靠性。在接近百万条链路的大规模 AI 集群里,可插拔的光模块每天可能出现数十次链路中断。铜缆是无源器件,没有激光器会老化,也没有信号处理芯片会发热,故障率低得多。

- 2026年GTC上,英伟达推出铜光混合的Vera Rubin NVL576和Rosa Feynman NVL1152系统。

- 2026年3月,英伟达向Coherent、Lumentum和Marvell投资60亿美元,锁定光学供应链。

- 英伟达在AI加速器市场占主导(份额超80%)。

- 光互连领域有博通、思科等玩家。

- 光模块成本高于铜缆。